L’intervention des gouvernements pour réguler l’intelligence artificielle (IA) va être «cruciale» afin de «limiter les risques» liés à cette technologie, a plaidé hier mardi Sam Altman, le patron d’OpenAI, créateur de l’interface ChatGPT qui déchaîne les passions.

«Il est essentiel que l’IA la plus puissante soit développée avec des valeurs démocratiques», a estimé le jeune entrepreneur devant une commission parlementaire américaine, «ce qui signifie que le leadership des Etats-Unis est déterminant».

La mise en ligne de ChatGPT, en novembre, a suscité un immense intérêt du public et des entreprises pour l’intelligence artificielle dite générative, c’est-à-dire capable de créer du contenu -texte, images, sons ou vidéo- après avoir été entraînée sur d’immenses bases de données.

«Vous avez sans doute pensé que c’était ma voix et mes mots, alors que ce n’était ni ma voix, ni mes mots», a déclaré le sénateur Richard Blumenthal, qui préside la sous-commission du Sénat sur la protection de la vie privée, la technologie et le droit. Il venait de faire entendre ses remarques préliminaires sur les dangers de l’IA, rédigées avec ChatGPT et lues par un logiciel entraîné sur sa voix réelle.

Les élus ont débattu avec le patron d’OpenAi et deux autres experts de la nécessité de réguler des systèmes informatiques qui pourraient « littéralement détruire nos vies », selon la formule du sénateur Lindsey Graham.

Créer une Agence fédérale

Sam Altman a rappelé que si OpenAI était une société privée, elle était contrôlée par une organisation à but non lucratif, qui «impose d’oeuvrer à la large distribution des bénéfices de l’IA et à maximiser la sécurité des systèmes basés sur l’IA», a-t-il ajouté.

Il a proposé la création d’une nouvelle agence fédérale, chargée d’attribuer des autorisations aux organisations qui développent des systèmes d’IA d’un certain niveau, et qui «pourrait les retirer si elles ne se conforment pas à des standards de sécurité».

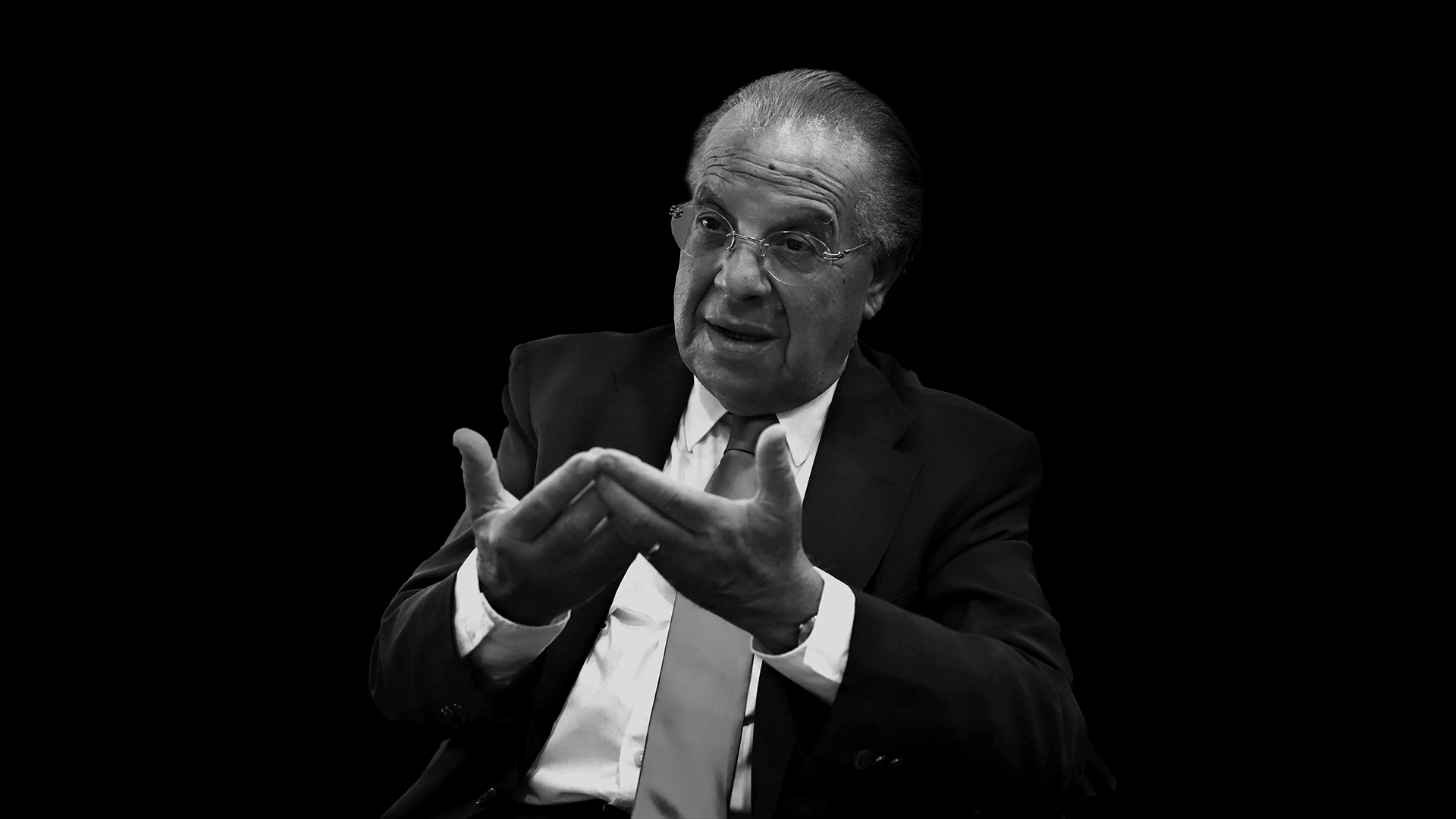

«L’une de mes plus grandes peurs, c’est que nous, cette industrie, cette technologie, causions des dommages significatifs à la société»

— Sam Altman, patron de Opel AI, créateur de l'interface d'intelligence artificielle ChatGPT.

Sam Altman s’est régulièrement dit favorable à la mise en place d’un cadre réglementaire pour l’intelligence artificielle, de préférence au niveau international. «Je sais que ça paraît naïf de proposer quelque chose comme ça» à réaliser, mais «il y a des précédents», a-t-il expliqué, évoquant l’exemple de l’Agence internationale de l’énergie atomique (AIEA).

Sam Altman a cependant noté les risques liés à trop de régulation: «Si l’industrie américaine ralentit, la Chine ou quelqu’un d’autre peut progresser plus vite». Il a aussi insisté pour que d’éventuelles mesures ne viennent pas étouffer la recherche indépendante, et se concentre plutôt sur les entreprises dominantes comme la sienne.

«Mauvais sens»

Pour l’instant, les Etats-Unis sont loin de suivre le chemin du Parlement européen, qui doit voter le mois prochain sur une nouvelle législation de vaste régulation de l’IA. Le Congrès américain évoque régulièrement la nécessité de mieux protéger la confidentialité des données et de favoriser plus de concurrence sur Internet. Mais les divisions politiques bloquent la plupart des propositions de loi depuis des années.

Le déploiement rapide de l’IA générative par OpenAI, Microsoft et Google a relancé la question de la régulation des technologies. Beaucoup s’inquiètent de son impact potentiel sur les professionnels, du risque de suppression d’emplois au vol de propriété intellectuelle.

«L’intelligence artificielle a le potentiel d’améliorer à peu près tous les aspects de nos vies», assure Sam Altman, «mais elle crée aussi des risques sérieux», a-t-il reconnu. «L’une de mes plus grandes peurs, c’est que nous, cette industrie, cette technologie, causions des dommages significatifs à la société», a-t-il affirmé. « Si cette technologie va dans le mauvais sens, elle peut aller assez loin. (...) Et nous voulons travailler avec le gouvernement pour empêcher que cela ne se produise. »